Des scientifiques ont créé un réseau social peuplé de bots, et le résultat est alarmant

Par Futurism .Publié le

2025/08/20 15:07

Août. 20, 2025

Ce n’est un secret pour personne : les réseaux sociaux se sont transformés en un cloaque toxique, infesté de désinformation et de discours de haine.

Sans la moindre pression pour mettre en place des garde-fous efficaces et des politiques applicables, ces plateformes sont rapidement devenues des chambres d'écho polarisantes, obsédées par un seul objectif : maintenir les utilisateurs accros à la colère et aux contenus abrutissants pour pouvoir leur afficher plus de publicités.

Et d'après les conclusions d'une récente expérience menée par des chercheurs de l'université d'Amsterdam, il se pourrait bien qu'elles soient condamnées à le rester.

Une étude sans appel

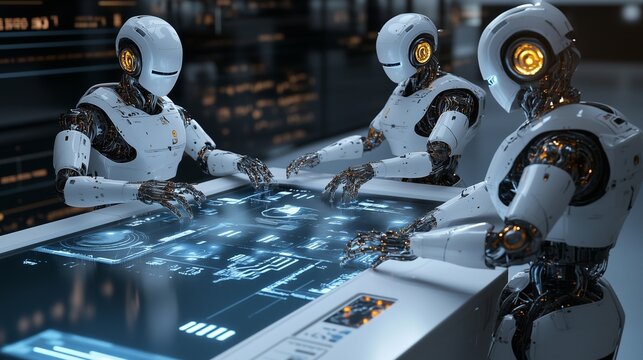

Dans une étude qui n'a pas encore été examinée par des pairs, les co-auteurs Petter Törnberg, professeur assistant en IA et réseaux sociaux, et son assistant de recherche Maik Larooij, ont simulé une plateforme sociale entièrement peuplée de chatbots alimentés par le modèle de langage GPT-4o d'OpenAI. L'objectif était de déterminer s'il était possible d'empêcher les réseaux sociaux de se transformer en chambres d'écho.

Ils ont testé six stratégies d'intervention spécifiques pour contrer cette polarisation, notamment :

Passer à des fils d'actualité chronologiques.

Mettre en avant des points de vue plus diversifiés.

Masquer les statistiques sociales (comme le nombre d'abonnés).

Supprimer les bios des comptes.

À leur grande consternation, aucune de ces interventions n'a fonctionné de manière satisfaisante, et certaines n'ont eu que des effets modestes. Pire encore, comme le rapporte Ars Technica, certaines ont même aggravé la situation. Par exemple, l'ordre chronologique a réduit l'inégalité d'attention, mais a fait remonter les contenus extrêmes en tête de liste.

Un avenir sombre ?

Cette réalité est un revers brutal pour les promesses des entreprises de créer une "place de village numérique" où tout le monde coexiste pacifiquement, comme l'a un jour décrit Elon Musk, le propriétaire de X. Avec ou sans intervention, les plateformes de médias sociaux semblent condamnées à se dégrader en un terrain fertile pour la pensée extrémiste.

« Pouvons-nous identifier comment améliorer les réseaux sociaux et créer des espaces en ligne qui honorent réellement ces premières promesses de fournir une sphère publique où nous pouvons débattre de politique de manière constructive ? » a demandé Törnberg à Ars.

Il a expliqué que ce ne sont pas seulement les contenus provocateurs qui engendrent des communautés polarisées. Le contenu toxique « façonne également les structures de réseau qui se forment », ce qui, à son tour, « affecte le contenu que vous voyez, créant ainsi un réseau toxique ». En conséquence, il y a une « inégalité extrême de l'attention », où seule une infime minorité de messages obtient le plus de visibilité.

À l'ère de l'intelligence artificielle générative, ces effets pourraient s'accentuer davantage. « Nous voyons déjà de nombreux acteurs – en se basant sur la monétisation des plateformes comme X – utiliser l'IA pour produire du contenu qui cherche à maximiser l'attention », a déclaré Törnberg. « La désinformation, souvent hautement polarisée, va prendre le dessus à mesure que les modèles d'IA deviendront plus puissants. »

Et de conclure : « J'ai du mal à imaginer comment les modèles de réseaux sociaux conventionnels pourront survivre à cela. »

Notez ce sujet