Les enseignants utilisent secrètement ChatGPT.

Par New York Times .Publié le

2025/04/20 22:18

Avril. 20, 2025

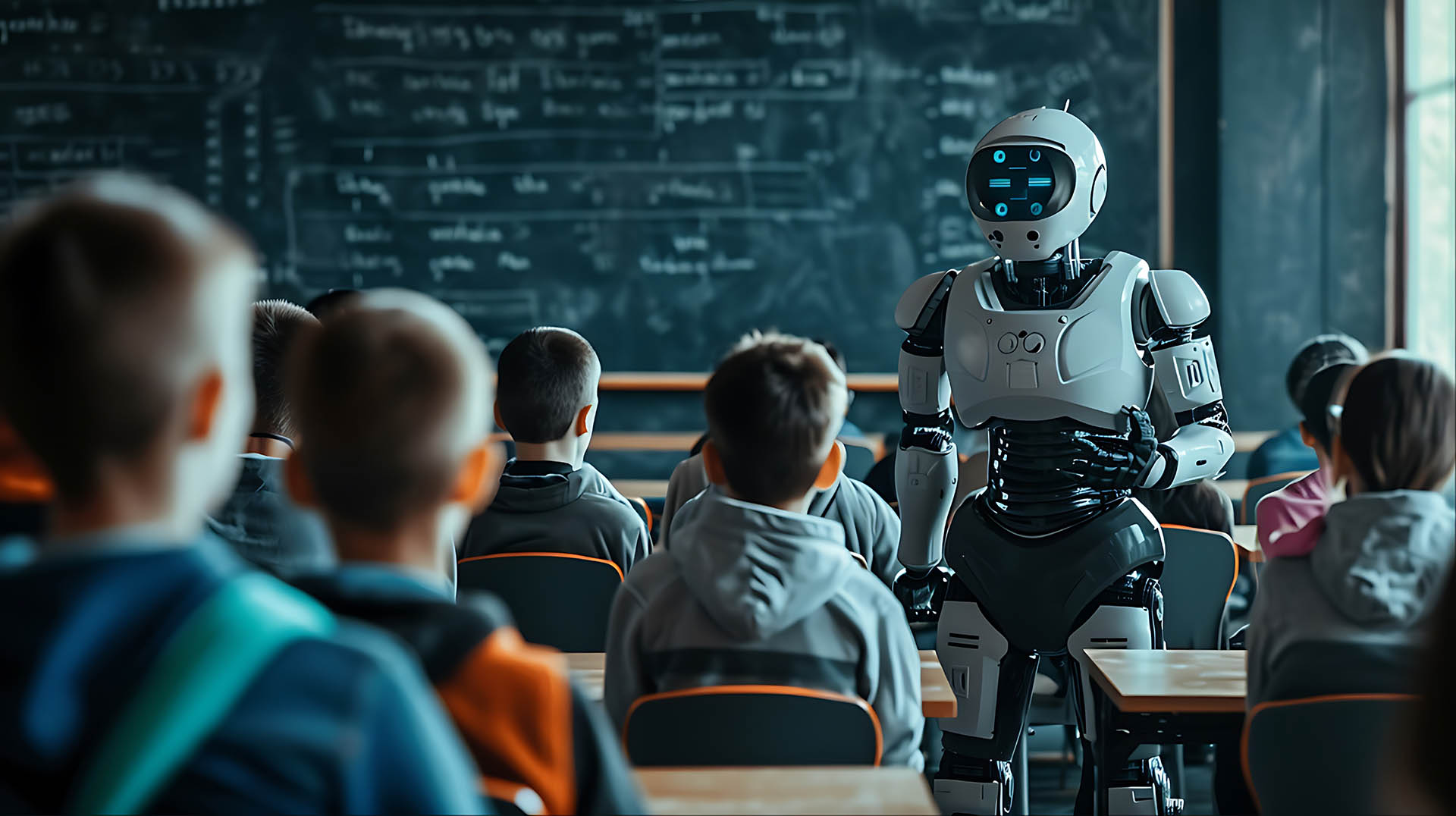

Un paradoxe émerge au sein du monde éducatif : des enseignants, de plus en plus nombreux à intégrer l'intelligence artificielle (IA) dans leur travail quotidien, interdisent catégoriquement à leurs élèves d'en faire de même.

Selon une enquête du New York Times, cette pratique s'étend de la correction des copies à l'assistance personnalisée des étudiants, voire même à l'analyse de leurs dossiers scolaires.

Pour Jon Gold, professeur d'histoire dans le Rhode Island, l'utilisation de ChatGPT pour élaborer ses plans de cours représente un usage relativement acceptable, qu'il communique d'ailleurs à ses classes en toute transparence. Néanmoins, il se montre inflexible quant à l'utilisation de cette même technologie par ses élèves pour la rédaction de dissertations ou la recherche documentaire.

« Je suis davantage favorable à une culture de l'IA qu'à son utilisation pure et simple », a déclaré M. Gold au NYT.

Jennifer Carolan, elle-même ancienne professeure d'histoire et fondatrice de la société d'investissement dans l'EdTech basée sur l'IA, Reach Capital, a insisté auprès du quotidien sur le fait que cette technologie « est déjà utilisée par la majorité des enseignants et des étudiants ». Ce chiffre informel pourrait toutefois être légèrement surestimé, étant donné qu'une récente étude de la RAND Corporation révèle que seulement 25 % des enseignants reconnaissent avoir recours à l'IA pour l'enseignement ou la préparation des cours. Cependant, ces réponses datant de l'année scolaire 2023-2024, il est probable que cette proportion ait augmenté depuis.

La tension entre l'usage de l'IA par les enseignants et son interdiction pour les étudiants semble encore plus marquée au niveau administratif. Ainsi, pour Alex Baron, administrateur d'une école charter à Washington, D.C., l'utilisation par les élèves d'applications appartenant à Alphabet telles que PhotoMath et Google Lens est considérée comme de la triche – tandis que son propre usage de cette technologie est, apparemment, légitime.

M. Baron a confié au NYT qu'il utilise fréquemment des programmes d'IA pour analyser les données académiques et comportementales des élèves et les répartir en groupes ciblés pour un soutien personnalisé. Bien qu'il n'ait pas précisé les applications utilisées, cet administrateur pro-IA, à l'instar de nombreux autres, dispose d'une multitude d'options. Le logiciel Securly Discern, par exemple, prétend aider les administrateurs à identifier et à soutenir les « élèves à risque » en surveillant leur comportement en ligne – en d'autres termes, en les espionnant et en informant le directeur.

Qu'ils utilisent l'IA à des fins louables ou discutables, les étudiants eux-mêmes sont loin d'apprécier l'idée que leurs professeurs tirent parti de technologies qui leur sont interdites. Interrogés par le NYT plus tôt cette année sur leur sentiment concernant l'utilisation de l'IA par les enseignants pour la notation – un usage particulièrement problématique en raison des erreurs fréquentes de l'IA – plusieurs ont qualifié cette pratique d'hypocrite, voire d'insultante.

« Si les élèves fournissent du travail et des efforts, pourquoi les enseignants devraient-ils avoir le droit d'être paresseux et de laisser l'IA noter à leur place ? », s'est indigné Aidan, un lycéen. « Cela donne l'impression que, parce que je suis plus âgé et votre supérieur, je peux utiliser l'IA et vous ne le pouvez pas, ce qui n'est pas un bon exemple pour les élèves. »

Une enseignante de Sacramento, se présentant sous le pseudonyme de LP, a quant à elle défendu son recours à l'IA.

« Les enseignants... ont obtenu des diplômes et souvent plusieurs masters », a-t-elle écrit. « Nous connaissons la compétence générative de la composition. Si nous pouvons utiliser l'IA pour faciliter la notation, nous pouvons consacrer plus de temps à la planification, à la préparation et au soutien des élèves. »

De toute évidence, il s'agit d'une question épineuse – et qui ne risque pas de disparaître à mesure que l'IA se normalise davantage.

Source: New York Times

Notez ce sujet