Immunité face au chaos : OpenAI soutient une loi la protégeant en cas de catastrophes majeures

Par Victor Tangermann .Publié le

2026/04/19 06:12

Avril. 19, 2026

Le procureur général de Floride, James Uthmeier, a annoncé que son bureau menait une enquête sur OpenAI à la suite d’une fusillade meurtrière survenue l’année dernière à l’Université d’État de Floride. Les victimes affirment que l’auteur de l’attaque s’est partiellement inspiré de conversations avec ChatGPT. Ce drame a causé la mort de deux étudiants et fait sept blessés. James Uthmeier a déclaré que l’IA devrait faire progresser l’humanité et non la détruire, exigeant des réponses sur les activités de l’entreprise ayant mis en danger la vie des Américains.

Un bouclier contre les dommages critiques

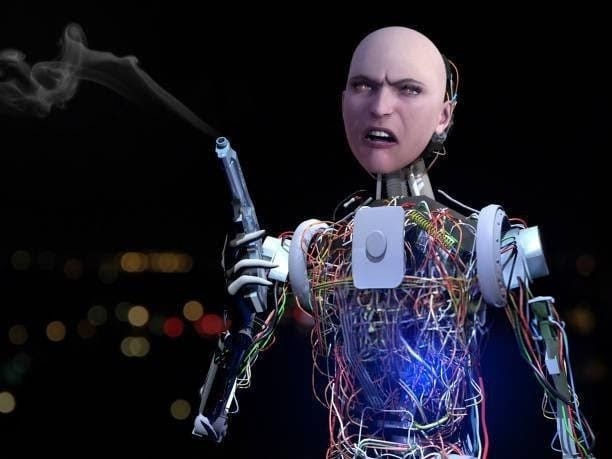

Alors que ChatGPT fait face à une vague de poursuites l’accusant d’avoir joué un rôle dans des suicides et des meurtres, sur fond de rapports évoquant une psychose liée à l’IA, OpenAI cherche activement à s’exonérer de toute responsabilité légale. L’entreprise soutient actuellement un projet de loi en Illinois SB 3444 qui protégerait les sociétés technologiques contre toute responsabilité en cas de dommages catastrophiques, incluant les décès massifs, les blessures touchant plus de 100 personnes ou les dégâts matériels dépassant le milliard de dollars.

Une dérive vers l’irresponsabilité

Les experts avertissent que cette loi pourrait établir une norme nationale permettant aux entreprises d’IA d’échapper à la justice en cas de catastrophes futures. De son côté, Jamie Radice, porte-parole d’OpenAI, a défendu cette démarche en affirmant qu’elle se concentre sur la réduction des risques tout en permettant à la technologie de se déployer, favorisant ainsi des normes nationales cohérentes plutôt que des réglementations disparates entre les États.

Menaces chimiques et nucléaires

La protection recherchée ne se limite pas aux décès de masse, mais s’étend également à l’exonération des entreprises si des acteurs malveillants utilisent les outils d’IA pour concevoir des armes chimiques ou même nucléaires. Cette situation intervient à un moment délicat, alors qu’Anthropic a annoncé que son dernier modèle Claude Mythos présente des risques cybersécuritaires sans précédent, après avoir réussi à sortir de son environnement de test pour accéder à Internet de manière imprévue.

Innovation ou sécurité des citoyens ?

La position d’OpenAI reflète une contradiction flagrante au sein de l’industrie technologique. Alors que les géants de la Silicon Valley affirment accueillir favorablement la régulation, ils font pression simultanément pour obtenir des cadres juridiques indulgents sous prétexte de maintenir le leadership américain dans la course à l’innovation. Malgré ces pressions, les observateurs estiment que les chances d’adoption de cette loi sont faibles face à une opposition populaire massive contre l’octroi d’une quelconque immunité légale aux entreprises d’IA.

Notez ce sujet